Etiquetas de IA serão implementadas em breve em todos os idiomas compatíveis com cada aplicativo.

A Meta está anunciando uma grande novidade para os próximos meses: será capaz de identificar qualquer imagem produzida por inteligência artificial (IA) nas plataformas Facebook, Instagram e Threads. Esta é uma grande evolução, já que a empresa já tinha anunciado a identificação de imagens feitas por robôs, utilizando a ferramenta Meta IA, lançada em dezembro. Com isso, a Meta reforça seu compromisso com a segurança digital e a transparência, se tornando uma referência no uso responsável da IA.

A inteligência artificial (IA) tem se mostrado cada vez mais presente em nosso dia a dia, e a Meta está acompanhando de perto essa evolução. Com a identificação de imagens geradas por IA, a empresa se destaca mais uma vez no campo da tecnologia e inovação. É importante ressaltar que a Meta está atenta aos possíveis impactos negativos da IA, agindo de forma responsável e proativa para garantir a segurança de seus usuários. A empresa está realmente comprometida em utilizar a inteligência artificial de forma ética e transparente, mostrando que é possível conciliar o avanço tecnológico com a proteção dos dados e da privacidade.

.

Inteligência Artificial (IA) na atualidade e seu uso nas redes sociais

Nos próximos dias, a empresa Meta irá rotular imagens publicadas no Facebook, Instagram e na plataforma Threads, cada vez que puder detectar indicadores de que as mesmas são geradas por IA, conforme as normas da indústria. De acordo com Nick Clegg, responsável por assuntos internacionais da Meta, a iniciativa visa trazer transparência para o uso de inteligência artificial (IA) e o desenvolvimento de imagens.

Além disso, há planos para expandir essa medida para conteúdos criados com ferramentas de outras empresas, como Google, OpenAI, Microsoft, Adobe, Midjourney ou Shutterstock, destacou Clegg. A ferramenta está em processo de construção e será aplicada nos próximos meses em todos os idiomas compatíveis com cada aplicativo.

A preocupação sobre o uso da IA generativa tem aumentado, especialmente em relação ao possível impacto político e ao risco de criação de conteúdo desinformativo. Com a aproximação do ano de 2024, em que quase metade da população mundial irá às urnas, o tema é ainda mais relevante.

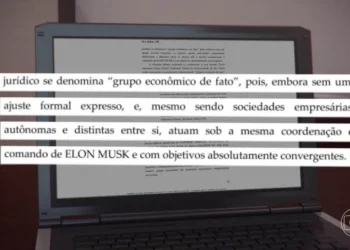

Para muitos ativistas e reguladores, a evolução de programas de IA generativa pode resultar em uma enxurrada incontrolável de conteúdo degradante, como as deepfakes pornográficas que têm afetado tanto figuras públicas quanto anônimas. Um exemplo recente foi a remoção de uma deepfake da cantora Taylor Swift, que circulou por 47 milhões de vezes antes de ser retirada da rede social X (ex-Twitter) no final de janeiro. A publicação permaneceu ativa por cerca de 17 horas na plataforma.

Apesar das medidas adotadas pela Meta, o risco de produção de imagens falsas ainda não será totalmente eliminado, segundo Clegg. Porém, a ferramenta certamente contribuirá para minimizar a proliferação desses conteúdos, dentro dos limites da tecnologia atual. O executivo destaca a importância da transparência proporcionada por essa iniciativa e acredita que ela incentivará a indústria a trabalhar conjuntamente no desenvolvimento de padrões comuns.

Nos últimos dias, a empresa OpenAI, conhecida pela criação do ChatGPT, também lançou ferramentas para combater a desinformação. A empresa californiana ressaltou a proibição do uso de suas tecnologias para propósitos políticos e salientou a importância de garantir que sua IA generativa não seja utilizada de maneira prejudicial ao processo democrático.

Com essas ações, tanto a Meta quanto a OpenAI demonstram a preocupação e responsabilidade crescente em relação ao uso da inteligência artificial e suas potenciais consequências. A transparência e o compromisso ético tornam-se prioridades diante do cenário atual.

Impacto das redes sociais na disseminação de imagens geradas por IA

O uso de redes sociais para disseminação de imagens geradas por IA está no centro das discussões em torno da ética e segurança digital. A preocupação com deepfakes, a proliferação de conteúdos degradantes e o impacto político destacam a necessidade de medidas eficazes e protocolos padrão para o uso dessas tecnologias.

Nick Clegg, líder da Meta, destaca a importância da implementação de etiquetas em imagens criadas por IA, como uma tentativa significativa de fornecer transparência e garantir a segurança dos usuários.

Por sua vez, a OpenAI ressalta sua preocupação em não permitir que sua tecnologia seja usada de maneira prejudicial ao processo democrático. O desenvolvimento de ferramentas para combater a desinformação e a ênfase em evitar o uso político de suas tecnologias demonstram o compromisso da empresa com a integridade e a segurança das plataformas digitais.

Fonte: © G1 – Tecnologia

Comentários sobre este artigo