Conteúdos iranianos sobre política e eventos globais, produzidos para sites e redes sociais, teveram baixa influência. Operação: melhorar engajamento com IA. Conteúdos: notícias, portais, veículos, progressistas vs conservadores, EUA, Storm-2035.

A OpenAI divulgou recentemente a proibição de contas associadas ao Irã que estavam utilizando o ChatGPT para influenciar a opinião pública em relação a diferentes assuntos, como as eleições nos Estados Unidos. O anúncio oficial foi feito pela empresa na última sexta-feira (16).

A medida tomada pela OpenAI demonstra o compromisso da empresa em combater a disseminação de desinformação e manipulação online. A decisão de banir as contas ligadas ao Irã que estavam utilizando o ChatGPT é um passo importante para garantir a integridade das plataformas digitais.

OpenAI e sua atuação na detecção de operações de influência iraniana

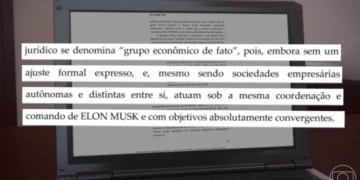

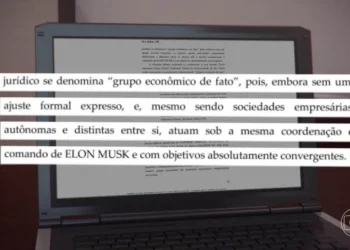

De acordo com a OpenAI, foi identificada uma ‘operação de influência iraniana’ que utilizava inteligência artificial para produzir conteúdos para as redes sociais e portais que se passavam por sites de notícias. A gigante de tecnologia revelou que essa operação, denominada ‘Storm-2035’, estava ativa, gerando material relacionado aos dois lados da campanha presidencial dos Estados Unidos. A análise da OpenAI indicou que os conteúdos veiculados nas redes sociais não obtiveram grande engajamento, sendo classificados como ‘categoria 2’, em uma escala que varia de 1 a 6. Isso sugere que, embora os materiais tenham sido compartilhados em diversas plataformas, seu alcance foi limitado.

A investigação da OpenAI apontou que a operação utilizava o ChatGPT com dois objetivos principais: a produção de textos extensos e a elaboração de comentários mais concisos nas mídias sociais. No primeiro caso, a operação elaborava artigos abordando temas relacionados à política dos EUA e a eventos globais, os quais eram publicados em cinco sites que se apresentavam como veículos de notícias progressistas e conservadores. Além disso, foram identificados conteúdos referentes aos Jogos Olímpicos, às eleições na Venezuela e ao conflito na Faixa de Gaza, ampliando a abrangência da operação.

A atuação da OpenAI na detecção dessas práticas evidencia a importância de monitorar e combater a disseminação de informações falsas e manipuladas nas redes sociais. A utilização da inteligência artificial para criar conteúdos enganosos representa um desafio significativo, exigindo a constante atualização de estratégias e ferramentas para preservar a integridade da informação online. A identificação de operações como a ‘Storm-2035’ destaca a necessidade de uma abordagem proativa na defesa da transparência e da veracidade das notícias veiculadas, especialmente em períodos eleitorais e contextos geopolíticos sensíveis.

Fonte: © G1 – Tecnologia